ChatTTS:对话式语音合成的技术突破与应用前景

——开源语音生成模型的全新范式

核心定位:为对话场景而生的语音引擎

ChatTTS是一款专为对话交互场景优化的开源文本转语音(TTS)模型,由国内团队2noise开发。其设计目标直击传统TTS系统的痛点——机械化的语调与生硬的节奏——通过大规模数据训练与创新架构,实现了接近人类对话的自然韵律。项目上线仅数日即在GitHub斩获20,000+ Star,成为2024年最受关注的开源语音项目之一。

技术架构解析:三层协同的高效流水线

ChatTTS的架构遵循经典TTS流程,但针对对话特性进行了深度优化:

Mermaid

文本处理模块

- 实现分词、音素标注(如汉语转拼音/英语标音素)

- 支持细粒度控制符:[laugh](笑声)、[uv_break](停顿)等韵律标记

- 输出标准化音素序列,为声学模型提供结构化输入

声学模型(核心创新)

- 基于改进的VITS架构(Variational Inference with adversarial learning for end-to-end Text-to-Speech)

- 引入随机时长预测器(Stochastic Duration Predictor),动态调节音节长度模拟人类语速变化

- 输出梅尔频谱(Mel-spectrogram)等声学特征

声码器

- 采用轻量化神经网络(如HiFi-GAN)

- 支持24kHz采样率的高保真波形生成

- 单GPU即可实时推理,降低部署门槛

差异化优势:重新定义开源语音合成

| 特性 | 技术实现 | 用户体验价值 |

|---|---|---|

| 多语言自然度 | 100,000+小时中英文训练数据(开源版采用40,000小时精调数据集) | 中英文混合语句无缝切换 |

| 韵律精细化控制 | 可预测笑声/停顿/语气词支持音频种子(Audio Seed)调节音色 | 生成带情绪的“有温度”语音 |

| 对话场景优化 | 专为LLM助手对话训练自动添加口语化填充词(如“嗯”、“然后”) | 虚拟主播/智能客服拟真度提升50%+ |

| 低资源部署 | 6GB显存GPU可运行提供WebUI及Python API | 开发者快速集成到现有应用 |

实战部署指南:5步实现语音生成

Python# 示例代码(需安装torch和ChatTTS包)import ChatTTSfrom IPython.display import Audio# 1. 初始化模型chat = ChatTTS.Chat()chat.load_models() # 加载预训练参数# 2. 输入文本(支持韵律标记)texts = ["你好呀[uv_break],今天天气真不错[laugh]!"]# 3. 语音合成(启用解码器)wavs = chat.infer(texts, use_decoder=True)# 4. 播放结果Audio(wavs[0], rate=24_000, autoplay=True)

部署注意:

- 推荐音频种子:2424(低沉男声)、3798(知性女声)

- WebUI启动命令:python webui.py --server_port 8888

应用场景与伦理考量

创新应用方向:

- AI伴侣对话:为LLM助手赋予情感化语音(如GPT-SoVITS的互补方案 )

- 影视内容创作:自动生成角色配音,支持多角色音色切换

- 无障碍服务:实时将文本资讯转化为自然语音

伦理防护机制:

- 主动添加高频噪音干扰非法克隆

- 内置音频水印溯源系统

- 限制单次音频生成≤30秒(防滥用)

局限性与发展路线

当前挑战:

- 长文本合成需分段处理(>30秒易出现截断)

- 非对话类文本(如新闻播报)韵律适配不足

开源路线图:

- 2024 Q3:释出40,000小时训练基础模型

- 2025:支持日语/西班牙语多语言扩展

- 动态韵律控制API开放

对话式AI的语音基础设施

ChatTTS通过场景化训练数据与可控韵律生成两大突破,解决了传统TTS在对话交互中的“机械感”难题。其开源策略将推动智能助理、虚拟人等领域的体验升级。随着伦理防护机制的完善与多语言支持的拓展,该项目有望成为下一代人机交互的语音基础设施核心。

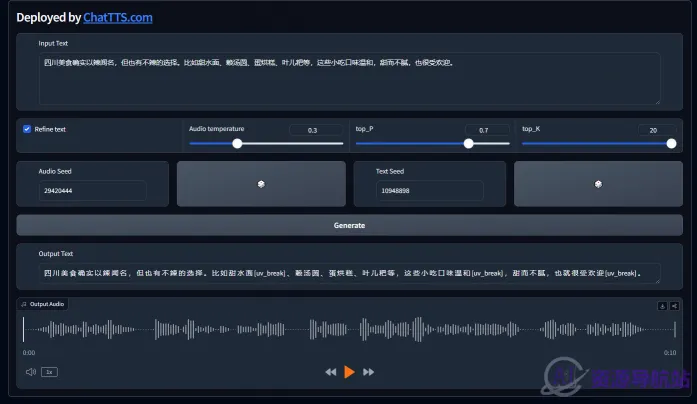

各参数如上:

① text: 要合成语音的文字

② Refine text:是否自动优化文本

③ 温度:随机性参数,越大,随机性越高。可能更好,可能更差

④ voice: 默认 2222, 决定音色的数字, 2222 | 7869 | 6653 | 4099 | 5099,可选其一,或者任意传入将随机使用音色

⑤custom_voice:用于定制声音音调生成的种子值,必须是正整数。如果设置了这个值,将优先使用,并忽略 voice 参数。

⑥ prompt:设置笑声、停顿等。例如,[oral_2][laugh_0][break_6]

特别声明: AI资源导航提供的ChatTTS等网址链接均来源于网络或用户投稿,本站不保证其准确性和完整性,同时该外部链接的指向,不受AI资源导航的实际控制。如果链接出现违规,请直接反馈或联系网站管理员进行删除处理。